Доналд Тръмп зад решетките? Владимир Путин паднал на колене пред китайския си колега Си Дзинпин? Може би сте засичали подобни изображения, които се разпространяват в интернет и са плод на бързия възход на изкуствения интелект, известен още като генеративен изкуствен интелект. Но как можете да различите истинско изображение от компютърно генерираното? Въпреки че няма сигурен метод за идентифициране дали дадено изображение е генерирано от изкуствен интелект, някои визуални и контекстуални улики могат да помогнат, казват специалисти пред AFP.

Неотдавна разработените инструменти за изкуствен интелект, като Midjourney, DALL-E, Craiyon или Stable Diffusion, могат да генерират безкраен брой изображения, използвайки огромни бази данни.

Мнозина си служат с тези инструменти за хумористични или артистични цели, но други разчитат на тях, за да създават изображения, които после да използват за политически новини.

Например след срещата между Путин и Си на 20 март 2023 г. в Twitter беше споделена серия от изображения, генерирани от изкуствен интелект. Други показваха френския президент Еманюел Макрон като сметосъбирач, в момент, в който парижките улици бяха залети с несъбрани боклуци на фона на масовите стачки заради пенсионната реформа, предизвикала недоволство.

Въпреки че повечето автори на тези широко споделяни изображения ясно да посочват, че те са изкуствено създадени, някои снимки се споделят извън контекст или са представени като автентични, като тази Facebook публикация на български, споделяща генерирано от изкуствен интелект изображение, показващо президента на САЩ Донал Тръмп, опитващ се да избегне арест.

Разработчици пуснаха инструменти като Hugging Face, чиято цел е да засичат подобни изкуствено създадени снимки. Резултатите обаче са противоречиви и в някои случаи могат да бъдат подвеждащи, показват тестове на AFP.

"Когато изкуственият интелект генерира снимки (от нулата), по принцип няма нито една оригинална снимка, от която да се вземат отделни части", казва Дейвид Фишингер, специалист по изкуствен интелект и инженер в Австрийския технологичен институт, пред AFP на 21 март. "Има хиляди/милиони снимки, които са били използвани за изучаване на милиарди параметри", добави той.

Винсент Тераси, съосновател на Draft & Goal, стартъп, който пусна детектор за АI в университетите, добави: "AI смесва тези изображения от своята база данни, деконструира ги и след това реконструира снимката пиксел по пиксел, което означава, че при окончателното визуализиране вече не забелязваме разликата между оригиналните изображения."

Ето защо софтуерът за откриване на манипулации не е особено ефективен, ако изобщо работи, при идентифицирането на изображения, генерирани от AI. Метаданните на снимката, които понякога могат да разкрият източника на изображението, генерирано от изкуствен интелект, също не помагат.

"За съжаление не може да се разчита на метаданните, тъй като в социалните мрежи те са напълно премахнати", казва пред AFP експертът по AI Аннализа Вердолива, професор в университета "Фредерик II" в Неапол.

Намерете първоизточника

Експертите казват, че важна улика е намирането къде и кога снимката е била публикувана онлайн за пръв път. В някои случаи създателят може да е посочил, че е генерирана от изкуствен интелект, и какъв е използваният инструмент.

Обратното търсене на изображения може да помогне, като се провери дали снимката е била индексирана в търсачките и се намерят стари публикации със същата снимка.

Този метод дава възможност да се намери източникът на изображенията, за които се твърди, че показват разправия, придружена с насилие, между бившия президент на САЩ Доналд Тръмп и арестуващите го полицаи.

Търсенето на обратни изображения в Google за една от тези снимки води до туит на Елиът Хигинс, основател на разследващия колектив Bellingcat, публикуван на 20 март 2023 г.

Хигинс обяснява в темата, че е създал серията от изображения с последната версия на Midjourney.

Ако не можете да намерите оригиналната снимка, обратното търсене на изображения може да доведе до по-качествена версия на снимката, в случай, че тя е била изрязана или променена преди да бъде споделена. Една по-ясна снимка ще бъде по-лесна за анализиране за грешки, които могат да са индикация за изкуствено създадено изображение.

Обратното търсене на изображения ще покаже и подобни снимки, което може да бъде ценно за сравняване на потенциални снимки, генерирани от изкуствен интелект, с такива от достоверен източник.

За добилото популярност изображение, за което се твърди, че показва Путин, коленичещ пред Си, потребители на Twitter като италианския журналист Давид Пуенте обърнаха внимание, че декорът в стаята е различен от този на снимките, публикувани от медиите, отразявали събитието:

Текстът под снимките и онлайн коментарите също могат да бъдат полезни за разпознаване на определен стил на съдържанието, генерирано от изкуствен интелект. Например DALL-E е известен с ултрареалистичния си дизайн, а Midjourney - със сцените, показващи известни личности.

Някои инструменти, като Midjourney, оставят следи от изображения, генерирани от AI, в различни канали за разговори.

Визуални улики

Дори без да знаете източника на дадена снимка, може да успеете да анализирате самото изображение с помощта на визуални улики.

Потърсете воден знак

Понякога уликите са скрити в снимката, като например воден знак, използван от някои инструменти за създаване на ИИ.

Например DALL-E автоматично генерира многоцветна лента в долния десен ъгъл на всички свои изображения. Crayion поставя малък червен молив на същото място.

Но не всички изображения, генерирани от изкуствен интелект, имат водни знаци. Те могат да бъдат премахнати, изрязани или скрити.

Съвети от света на изкуството

Тина Никуха, докторант, изучаващ обработката на изображения в университета ENS Paris-Saclay, казва пред AFP: "Ако се съмнявате, погледнете зърнеността на изображението, което ще бъде много различно за снимка, генерирана от изкуствен интелект, от това на истинска снимка."

Използвайки безплатни версии на инструменти за изкуствен интелект, AFP генерира изображения, които имат стил, подобен на картините на хиперреалистичното движение, като например левия пример по-долу, показващ изображение на Брад Пит в Париж.

Друго творение по-долу вдясно е създадено с подобни ключови думи на DALL-E. Изображението не е толкова очевидно генерирано от изкуствен интелект.

Но не всички изображения, генерирани от изкуствен интелект, имат водни знаци. Те могат да бъдат премахнати, изрязани или скрити.

Съвети от света на изкуството

Тина Никуха, докторант, изучаващ обработката на изображения в университета ENS Paris-Saclay, казва пред AFP: "Ако се съмнявате, погледнете зърнеността на изображението, което ще бъде много различно за снимка, генерирана от изкуствен интелект, от това на истинска снимка."

Използвайки безплатни версии на инструменти за изкуствен интелект, AFP генерира изображения, които имат стил, подобен на картините на хиперреалистичното движение, като например левия пример по-долу, показващ изображение на Брад Пит в Париж.

Друго творение по-долу вдясно е създадено с подобни ключови думи на DALL-E. Изображението не е толкова очевидно генерирано от изкуствен интелект.

Изображение, генерирано от изкуствен интелект с помощта на Stable Diffusion на 22 март 2023 г., използващо фразата: "Брад Пит, улица на Париж, ранна и слънчева сутрин, държи кроасан, близо до пекарна и стара френска кола, облечен в бяла риза, усмихнат, реалистичен, 4K"

Изображение, генерирано от изкуствен интелект, създадено на 22 март 2023 г. с помощта на DALL-E и фразата: "Брад Пит в Париж, снимка, магазини на заден план, 4K"

Визуални несъответствия

Въпреки стремителния напредък в областта на генеративния изкуствен интелект, в съдържанието, генерирано от AI, все още се появяват грешки. Тези дефекти са най-добрият начин за разпознаване на фалшифицирано изображение, твърдят специалисти пред AFP. При генеративен процес могат да се получат артефакти, които не трябва да бъдат в крайния резултат.

"Някои характеристики, често едни и същи, представляват проблем за AI. Именно тези несъответствия и артефакти трябва да се разлеждат внимателно, като в играта "Открийте разликите", казва Тераси от Draft & Goal.

Вердолива от Университета "Фредерик II" в Неапол обаче предупреждава: "Методите за генериране се усъвършенстват с течение на времето и показват все по-малко артефакти на синтеза, така че не бих разчитал на визуални улики в дългосрочен план."

Например към март 2023 г. все още е трудно да се генерират реалистични ръце. Генерираната от изкуствен интелект снимка на Пит на AFP показва актьора с непропорционално голям пръст.

През февруари 2023 г. журналист от AFP откри, че на серия от снимки, за които се твърдеше, че са направени по време на демонстрация срещу реформата на френската пенсионна система на 7 март 2023 г., един от полицаите има шест пръста.

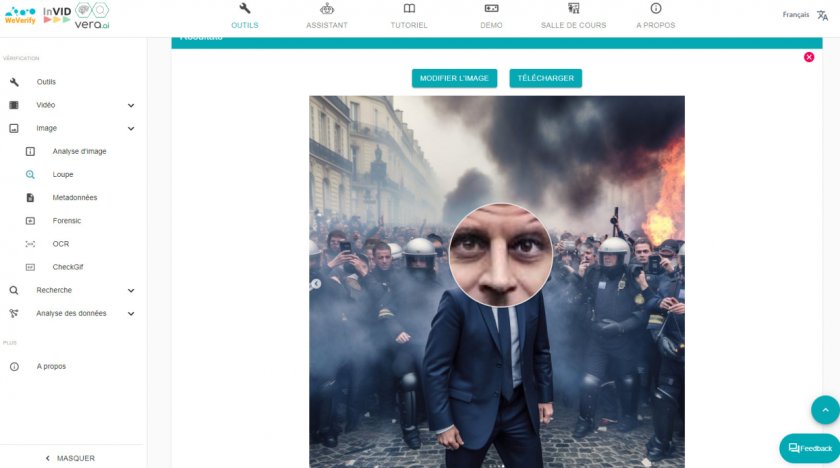

"Засега изображенията с изкуствен интелект също се справят много трудно с генерирането на отражения", казва Тераси. "Добър начин да се открие AI е да се търсят сенки, огледала, вода, но също така да се увеличат очите и да се анализират зениците, тъй като при снимка в тях обикновено има отражение. Също така често можем да забележим, че очите не са с еднакъв размер, а понякога са с различни цветове".

Използването на лупата в инструмента Invid-WeVerify подчертава разликата в цвета на двете очи на тази генерирана от изкуствен интелект снимка на Макрон, споделена в Instagram. На снимката не само са изобразени два различни нюанса на кафявото, но Макрон всъщност има сини очи.

Генераторите също често създават асиметрии. Лицата могат да бъдат несъразмерни или пък ушите да имат различни размери.

Зъбите и косата са трудни за имитиране и могат да разкрият по своите очертания или текстура, че изображението не е истинско.

Някои елементи могат да бъдат лошо интегрирани, като например слънчеви очила, които се сливат с лицето.

Експертите също така отбелязват, че смесването на няколко изображения може да създаде проблеми с осветлението в снимка, генерирана от изкуствен интелект.

Екранна снимка на публикация в Instagram, генерирана от AI и публикувана от @joannsfar

Екранна снимка на публикация в Instagram, генерирана от AI и публикувана от @joannsfar

Проверете фона

Добър начин да откриете тези аномалии е да се вгледате във фона на снимката. Макар на пръв поглед да изглежда нормален, генерираната от изкуствен интелект снимка често съдържа грешки, като например в тези снимки, на които уж са показани Барак Обама и Ангела Меркел на плажа.

Една от фигурите на заден план изглежда с отрязани крака.

"Колкото по-далеч е даден елемент, толкова повече обектът ще бъде размазан, изкривен и с неправилна перспектива", казва Тераси.

На фалшивата снимка от срещата между Си и Путин една линия на колона не е права. Главата на руския лидер също изглежда непропорционална в сравнение с останалата част от тялото му. Фишингер заяви пред АФП, че несъответствията разкриват изображение, генерирано от изкуствен интелект.

На тази фалшива снимка на Си Дзинпин и Владимир Путин се виждат несъответствия

На тази фалшива снимка на Си Дзинпин и Владимир Путин се виждат несъответствия

Използвайте здрав разум

Някои елементи може да не са изкривени, но все пак могат да издават логическа грешка. "Добре е да разчитате на здравия разум", когато се съмнявате в дадено изображение, oбяснява той.

На снимката по-долу, генерирана от AFP на Midjourney и целяща да покаже Париж, има пътен знак в синьо, забраняващ влизане, какъвто не съществува във Франция.

Снимка, генерирана с Midjourney на 22 март 2023 г. от AFP, използваща фразата: "Брад Пит, улица на Париж, ранна и слънчева сутрин, държи кроасан, близо до пекарна и стара френска кола, облечен в бяла риза, усмихнат, реалистичен, 4K"

Тази улика, съчетана с насечените пръсти на главния герой, пластмасовия кроасан и разликата в осветлението на някои прозорци, подсказва, че снимката е генерирана от изкуствен интелект.

Водният знак в долния десен ъгъл на изображението премахва всяко съмнение и показва, че изображението е генерирано с DALL-E.

И накрая, ако за едно изображение се твърди, че показва конкретно събитие, но достоверността му буди съмнение, потърсете надеждни източници, за да намерите евентуални несъответствия.

Източник: БНТ

Още от категорията

Виж всички

Вълна от съкращения в IT сектора: AI се превръща в основен двигател на промяната

Google променя драстично търсачката си